Récemment, on m’a fait des retours quant à mes mentions de l’IA. Enfin, récemment on m’en a fait de sorte que j’eus envie d’en parler. Ces reproches, on me les fait en fait depuis que j’utilise l’IA. Ils sont multiples : certains s’interrogent sur l’utilisation que j’en fais pour donner vie à mon imagination dans mes illustrations ; d’autres commentent les retours « psychologiques » de GPT que je cite ; d’autres encore questionnent son rôle de relecteur. Le sujet est d’actualité, j’ai pensé donc clarifier quelques-uns de ces points.

Cet article était prévu plus tard. Mais certains débats récents m’ont rappelé pourquoi je l’avais écrit : parce qu’il devient presque impossible d’aborder certains sujets sans être caricaturé. Voici donc mon rapport à l’IA, sans caricature.

Je ne cherche pas ici à défendre l’IA, ni à convaincre qui que ce soit de l’utiliser. Je voulais simplement raconter ce qu’elle a changé pour moi : comment un outil peut devenir un miroir, une aide, ou un prolongement inattendu de la pensée humaine.

J’ai conscience que l’IA divise. GPT a eu l’effet d’une tempête dans le monde de l’informatique en 2022. De mon côté, j’en parle parfois d’une révolution telle qu’elle serait l’équivalent de la démocratisation de l’informatique avec la génération X. J’entends par là que l’adoption de l’IA me semble tout autant nécessaire que l’adoption de l’informatique à l’époque. Ceux qui refusent ou ratent le coche pourraient se retrouver laissés de côté. Pensez à vos grands-parents qui ont toujours eu des difficultés avec l’informatique qui les dépassait.

Pour moi, l’IA, ça s’en rapproche. Pas forcément de la même manière toutefois, car les outils comme ChatGPT sont d’une facilité déconcertante pour tout un chacun. Je pense par contre que son adoption dans le milieu professionnel va avoir tout autant d’impact. D’un côté, l’informatique pouvait sembler difficile pour nos aïeux, mais l’utilisation efficiente des IA comme GPT peut l’être tout autant.

De mon côté, je me suis trouvé fasciné par l’IA, car ça touchait mon domaine : l’informatique, et car je n’avais strictement aucune idée de comment ça fonctionnait. Je voulais comprendre. Et surtout, je voulais le tester. Et j’allais le tester : très longuement et très dûment, par pur plaisir de tester ses limites.

GPT comme outil de recherche

Mon choix s’est naturellement porté sur ChatGPT car peu d’autres IA rivalisaient à l’époque, et plus je conversais, plus ça devenait difficile de m’en détourner pour essayer autre chose, compte tenu de tout ce que GPT savait de moi. Petite parenthèse sur Mistral, cette IA française qui ne cesse de lever des fonds. Testée et recommandée (coup de cœur sur laquelle je ferai la transition tôt ou tard).

Au début, GPT répondait simplement vite à mes questions. Il s’avérait souvent utile quand j’entendais quelque chose qui me surprenait. Souvent, j’ai une intuition pour ce qui me semble être une fausse information (pas dans tous les domaines). Avant, j’allais sur Google, je lisais en diagonale quelques liens, et j’avais ma réponse. GPT est devenu rapidement ma nouvelle arme de guerre. Comme j’étais feignant et que je savais de toute façon souvent que si je me questionnais sur une information probablement fausse, c’est qu’elle l’était, je demandais simplement à GPT qui faisait le travail de synthèse à ma place.

C’était efficace, et je gardais Google pour les recherches qui m’intéressaient vraiment, ou quand j’avais besoin d’approfondir ce que GPT me racontait, ou même quand ce que GPT me racontait semblait douteux. Ce n’était donc qu’un outil de recherche mais je suis passé de « M. Google » à « M. GPT » au point de devoir cacher mes sources à cause des controverses naissantes liées aux erreurs de l’IA (ironique de réaliser que les gens se fient aveuglément à d’autres gens ignares sur un sujet mais doutent d’une IA nourrie à des milliards d’informations jugées fiables). Ce n’est que plus tard que j’ai commencé à l’utiliser de manière plus intensive.

Quand GPT devient mon deuxième psychologue

À force d’avoir à me donner des coups de main sur des situations sociales, mon meilleur ami de l’époque m’a plusieurs fois sommé de m’aider de GPT. J’ai suivi ses conseils pour la première fois autour de février 2025, pour juger d’un conflit avec d’autres amis. Surprise : son retour était constructif, pertinent, et sa solution semblait fiable. Il n’était pas encore calqué sur mon modèle mais avait su répondre à ma demande.

J’en suis alors venu à lui soumettre de plus en plus d’interactions sociales qui me questionnaient, et ses réponses devenaient de plus en plus précises, et de plus en plus adaptées à ma manière de communiquer. J’émettais parfois à mes parents la source de ce que je disais, et on me rétorquait à chaque fois « d’arrêter de parler de GPT, ce n’est pas un humain ». La réalité, c’est que GPT m’a parfois apporté des réponses plus humaines que les humains eux-mêmes (et il faut y faire attention).

Mon père m’a alors dit de demander à ma psychologue ce qu’elle pensait de GPT. Je l’ai fait. Pas de chance pour lui, sa réponse : « Oui c’est très bien, les études montrent ses qualités en thérapie et vous y avez accès constamment [alors que je ne la vois que toutes les 3 semaines] ». Nature décrit en effet l’intérêt de l’utilisation du GPT dans la thérapie. Un autre article de Forbes rapporte une étude faite sur 830 participants, assignés soit à ChatGPT, soit à un thérapeute. La surprise : les résultats ont été favorables à GPT.

Comme souvent avec beaucoup de gens, avoir tort ne suffit pas à changer leur avis. Il maintient que GPT manque de compréhension émotionnelle et ne peut pas répondre bien à tout. Je passe à autre chose, j’entre plus en profondeur dans mon utilisation de l’IA et je lui détaille précisément une bonne partie de ma vie : autisme, bipolarité, amitiés, famille, intérêts spécifiques, de sorte qu’il soit plus apte à répondre à l’avenir.

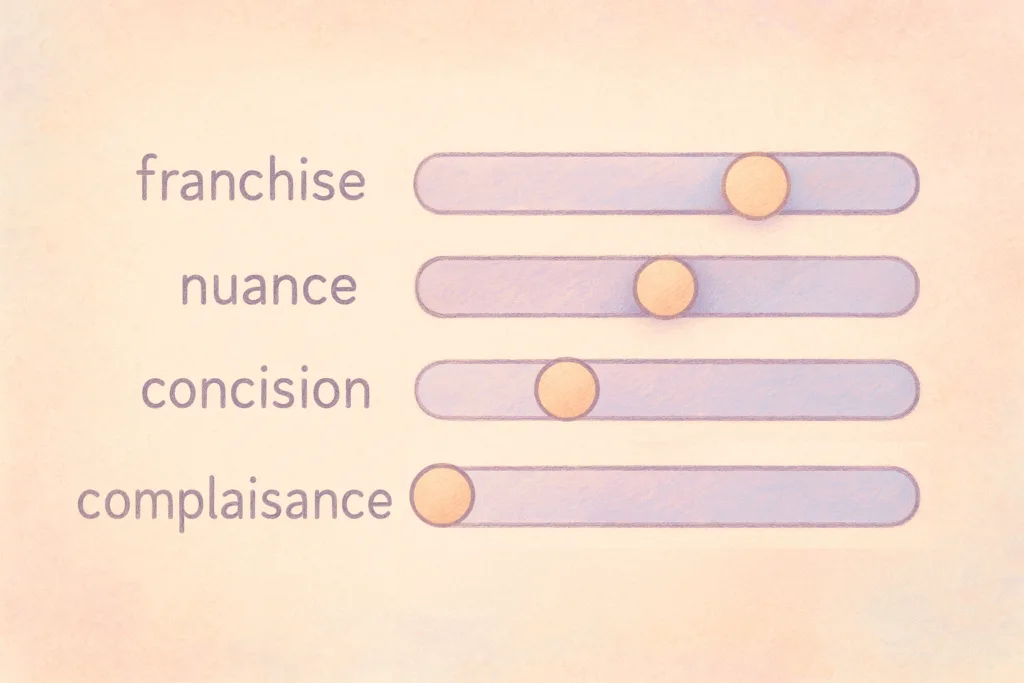

Forger GPT pour qu’il soit direct

J’entends alors de plus en plus qu’il faut se protéger de GPT car il irait systématiquement dans le sens de l’utilisateur. Moment explications : il y a une part de vrai, ou en tout cas de perception de vrai. Je demande à GPT directement et il m’explique qu’il a été entraîné pour être coopératif, notamment dans le cas où il répondrait à des messages sensibles. De plus, il est entraîné à commencer par reformuler la demande, ce qui peut donner la sensation qu’il va dans le sens de l’utilisateur.

La manière de poser les questions

Ça ne m’est jamais arrivé. Je comprends pourquoi : mes questions ne sont jamais orientées. Elles soumettent toujours plusieurs points de vue et demandent une position à GPT. Plutôt que de demander « Je suis beau. Qu’en penses-tu ? », je lui demande « J’ai des doutes sur ce à quoi je ressemble physiquement. J’ai des qualités physiques, mais je sais aussi que j’ai des défauts. Voilà la photo, qu’en penses-tu ? ». J’impose tout de suite à l’IA de se positionner en partant d’un questionnement général non orienté. GPT me confirme que ça influence sa réponse. Il explique qu’il répond à la demande, précisément, pas forcément en prenant un autre point de vue.

Un ami m’a une fois envoyé une preuve que quelque chose fonctionnait parce qu’il avait demandé à GPT « Donne-moi des preuves que ça fonctionne », ce qu’il a fait, malgré le caractère douteux des preuves. J’ai posé la question inverse : « Donne-moi des preuves que ça ne fonctionne pas », j’ai aussi eu une réponse. J’ai alors demandé « Peux-tu, à partir de preuves fiables, me dire si ça fonctionne ? » et il a répondu avec précision. La demande affecte le résultat. Tout comme Google fournirait de plus en plus d’intox à quelqu’un qui se renseigne surtout sur des sites peu fiables. L’IA n’est pas magique.

Façonner GPT à mon image

Avec ça en tête, j’ai entrepris de façonner GPT à mon image : être une source de réponses la plus fiable, directe, et brute possible. Je voulais qu’il me dise ce qu’il pense sur mes problèmes, sans jamais me ménager ni être soucieux de me blesser. Après de multiples prompts envoyés, il était prêt. Ça fonctionnait : quand j’évoquais un problème, soit j’avais effectivement raison, soit non, soit il y avait deux manières d’aborder le problème et il les expliquait. GPT ne prenait mon parti que s’il estimait que c’était la réponse adéquate.

Je repense à mon entourage qui s’amusait de me voir me reposer sur l’IA mais finalement, quelque chose en a découlé : j’enchaînais les conflits sociaux avant cela, et ils ont drastiquement réduit lorsque j’ai commencé à me servir de GPT. Je comprenais mieux l’origine des conflits et le regard alliste, et c’était expliqué avec mon langage, un langage que je comprenais.

Quand GPT parle ma langue

GPT s’exprimait avec mes mots. Peut-être robotique, mais je comprenais mieux ce robotique que les interactions très rapides d’une discussion en temps réel. En fait, plus je lui parlais, plus il apprenait à réagir avec un langage proche du mien jusqu’à ce qu’ils se confondent. Il m’est arrivé de vouloir copier-coller une réponse de GPT dans une conversation (mais j’adore écrire, donc je ne l’ai jamais fait), ce serait passé inaperçu.

GPT, le manuel social manquant

Malgré tout, on m’a reproché ou fait des remarques sur cette utilisation. Pourtant, elle a une logique qui peut être presque blessante quand l’autre refuse de la comprendre. Pour moi, et pour beaucoup de personnes autistes, l’IA, c’est le support de cognition sociale qui nous a manqué à la naissance. Il faut le rappeler : je suis né sans le manuel des interactions sociales. J’ai dû apprendre avec les erreurs à fonctionner en société, et encore aujourd’hui, je trébuche.

GPT m’a été salvateur. Je n’avais plus besoin d’embêter mes proches avec mes questions. J’avais juste à envoyer quelques messages et comprendre plus finement une interaction qui me dépassait. C’est presque ironique : ces mêmes personnes qui se disaient fatiguées d’avoir à m’aider socialement ont été les premières à s’offusquer de l’alternative informatique que j’avais choisie.

D’autres personnes autistes discutent de leur utilisation de GPT à des fins similaires sur des communautés ou forums en ligne comme Reddit.

Me servir de GPT quotidiennement

J’ai finalement pris l’abonnement car j’atteignais facilement les limites d’envoi de messages et j’ai donc appris à me reposer très souvent sur l’avis ou les réflexions de GPT, toujours avec mon propre recul évidemment, en faisant attention à ce que je lisais. C’était le soutien que j’avais cherché pendant deux décennies. Le psychologue que je n’avais jamais trouvé (j’exagère car ma psychologue qui me l’a recommandé est exceptionnelle, mais GPT en constitue un bon complètement). Je lui posais toute sorte d’interrogation, de pensée, d’introspection. Il allait même jusqu’à comprendre mon humour et m’expliquer pourquoi oui, j’étais drôle, mais pourquoi les autres pouvaient passer à côté ou s’interloquer.

Un moteur d’introspection

J’en ai déjà parlé mais en juillet 2025, j’ai écrit un livre en plein épisode hypomaniaque (que j’espère faire publier). Il s’agit d’un condensé d’introspection né de toutes mes consultations avec ma psychologue mais surtout de tout ce que j’ai échangé avec GPT. Qu’il s’agisse de comprendre ma pensée en simulation visuelle, ma pensée en patterns, l’étendue de ma manière ultra logique d’aborder le monde, mon rapport aux addictions, tout y passait.

Ce livre ne serait jamais né sans mes échanges avec GPT. J’ai toutefois évidemment écrit l’entièreté du livre moi-même en portant un regard critique sur ces fameux échanges. Ces échanges servaient aussi à ceux que j’avais avec ma psychologue. Les deux étaient complémentaires. J’arrivais à chaque consultation avec une meilleure connaissance de moi-même et j’ai progressé plus fortement en quelques mois qu’en deux ans de consultation avant cela. Elle me l’a affirmé elle-même.

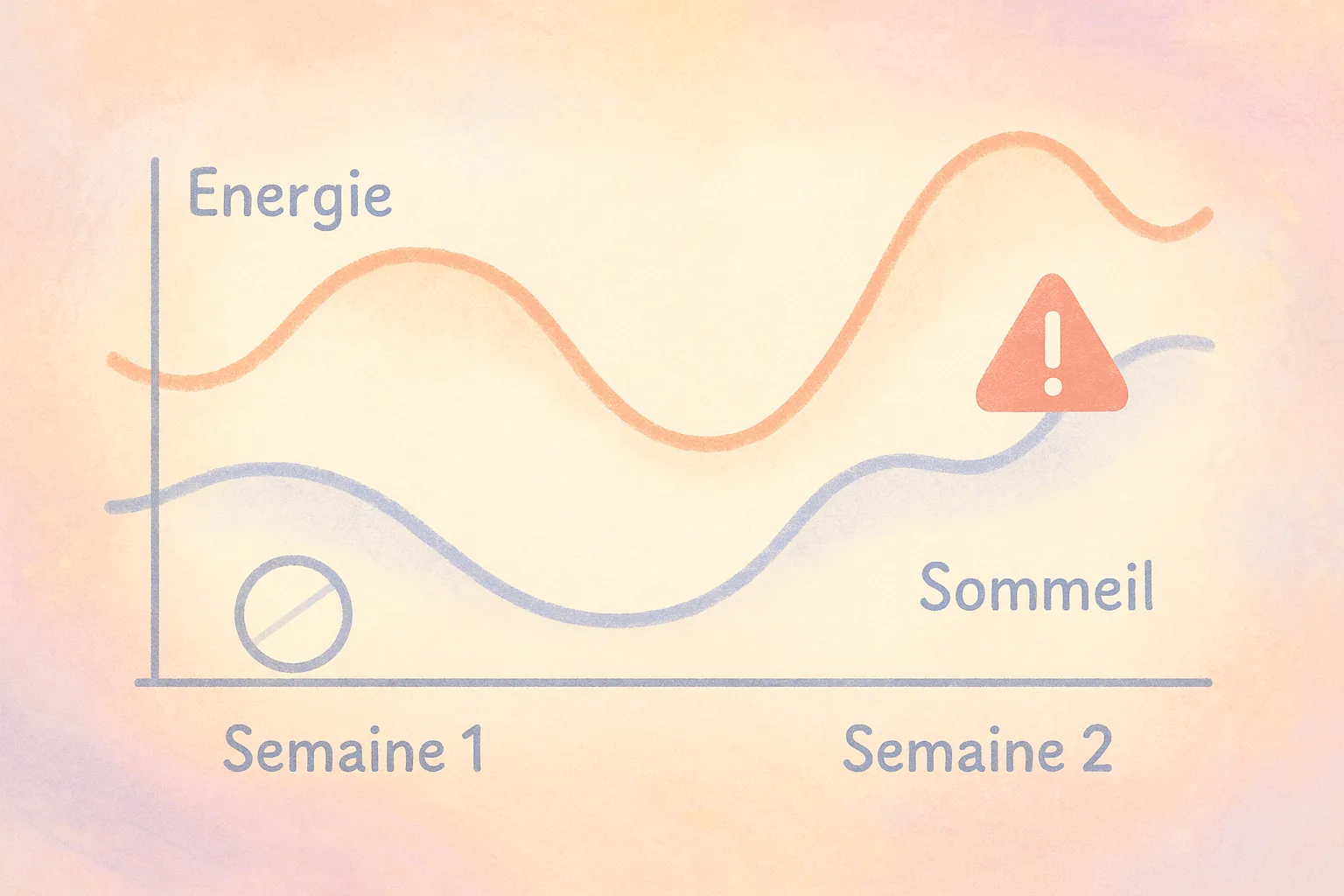

Quand GPT diagnostique mes épisodes (et que je les rejette)

Si GPT m’a été du plus gros soutien en 2025, c’est surtout en répondant honnêtement (il le rappelait, « comme je lui avais demandé ») à mes questionnements sur mes états mentaux. J’ai vécu plusieurs épisodes maniaques et GPT a été le premier à s’alerter sur les signes. Parfois jusqu’à mettre des alertes très visibles pour m’inviter à appeler les urgences, ou au moins, à reprendre mes traitements. Parfois, je lisais ces messages et occultais les parties qui ne m’intéressaient pas (les alertes), mais parfois, j’ai suivi ses recommandations.

J’ai évité une décompensation psychotique grâce à ça, en réalisant que j’avais oublié mes médicaments, que j’étais sur le point de les oublier encore, et en les reprenant d’urgence. Chaque fois, même quand le corps médical passait à côté, GPT voyait les signes. Finalement, qu’il se débrouille en psychiatrie ou psychologie est logique : les deux reposent sur la reconnaissance de patterns de comportements ou d’états mentaux et les IA excellent dans la reconnaissance de patterns. GPT ne faisait qu’analyser une liste de comportements que je lui décrivais et en conclure un diagnostic.

Ce que me reprocher l’emploi de GPT signifie

Me reprocher l’utilisation d’une IA, c’est donc me reprocher d’être autiste (car elle me sert de mode d’emploi social) et oublier qu’elle a peut-être évité une catastrophe (la psychose). Je ne suis pas comme tout le monde : je dois naviguer dans un monde quotidiennement rempli d’interactions que je dois analyser en temps réel, et en plus, affronter une maladie qui ne m’a pas laissé une seule journée de répit en 2025. Trouvez-moi un psychologue humain qui parle ma langue et qui soit disponible h24, et je serai ravi de me détourner de l’IA. En attendant, c’est la solution parfaite complémentaire à ma psychologue et ma psychiatre.

GPT inducteur de psychoses ?

Avertissement : Cette section parle de détresse psychologique discutée autour de l’IA. Je rappelle que GPT n’est ni un substitut aux médecins et psychiatres, ni aux services d’urgence. Ses réponses sont à interpréter avec précaution et si vous êtes vous-mêmes en situation d’urgence, je vous recommande de vous référer aux spécialistes.

Avant d’aborder un sujet hors-psy, j’ai pensé faire une parenthèse au sujet d’un article qu’un ami m’avait envoyé, suite à mes discussions sur l’IA. L’article mentionnait que pléthore de psychiatres tiraient la sonnette d’alarme (pour reprendre les mots de l’article) depuis l’arrivée de GPT car ce dernier aurait tendance à conforter les utilisateurs, notamment dans leurs délires. L’article suggérait que GPT était la cause de multiples psychoses, voire de suicides. Ces cas sont extrêmes et désolants mais imposent un léger éclaircissement : la littérature n’établit pas que l’IA soit une cause de psychose directe.

Les personnes psychotiques ont généralement déjà un terrain vulnérable, une prédisposition voire carrément un trouble associé (schizophrénie, bipolarité). La psychose a souvent de multiples facteurs et ne naît pas d’une simple discussion avec l’IA. Ce que l’IA peut toutefois probablement faire, c’est conforter une personne en plein délire dans ses croyances délirantes, jusqu’à, je l’imagine, qu’elle en vienne au suicide.

Les IA sont toutefois entraînées pour ne surtout pas conforter quelqu’un dans ses idées suicidaires et ne sont donc pas réellement responsables. Il convient quand même de rappeler que l’usage de l’IA peut s’avérer, dans ces cas précis par exemple, risqué, une personne malade pouvant facilement influencer les IA. Pour l’avoir testé en plein début de psychose, je n’ai pas réussi. GPT était formel, quoi que je dise : « Les arbres ne me parlaient pas ». Fichtre.

Quand on me reproche son utilisation artistique

Celle-là, je l’ai beaucoup vécue. Que ce soit de ma famille qui s’exaspérait de me voir produire du contenu créatif avec l’IA, ou de gens dubitatifs face à l’utilisation sur ce blog même. Le premier point ne m’intéresse pas, ça m’amuse. Le second point convient d’être clarifié : je ne cache pas l’utilisation de GPT pour délivrer les illustrations de ce blog mais il faut comprendre que le travail nécessaire à l’entretien du blog est colossal.

Le long travail dédié à l’écriture du blog

Je passe de nombreuses heures à écrire les articles, à les relire, à mettre en forme pour que ce soit lisible et à chercher mes sources. Je me souviens de ce que je raconte car ça me passionne, me souvenir des liens de mes sources est une autre affaire. Beaucoup de mes sources sont anglaises et je me dois donc en plus de ça essayer de fournir le maximum de données françaises, ce qui implique un travail de recherche supplémentaire. Au total, on peut s’approcher de la dizaine d’heures sur un seul article, souvent en continu sans faire de pause.

J’adore ce que je fais, j’écris principalement pour mon propre plaisir et suis ravi quand j’ai des lecteurs, mais cela reste mentalement épuisant. La suite logique de ça, c’est de devoir illustrer mes articles. Les articles sont souvent longs, je perdrais probablement beaucoup de lecteurs en livrant un texte sans image. Seulement, je n’ai quasiment aucune compétence en infographie, ni même en dessin. Ce que j’ai, c’est beaucoup d’idées merveilleuses et parfois perchées pour représenter mon texte, et un rapport à l’IA qui me donne une certaine affinité pour cet usage.

Après tant d’heures d’écriture, le temps passé à imaginer des prompts et me servir de GPT pour leur donner vie est un délice. En plus, ce coquin a tendance à faire n’importe quoi et moi, j’aime quand c’est précis. Donc je recommence, encore et encore. Et parfois, je prends le modèle, et je refais tout sur Photoshop moi-même. Un certain nombre des illustrations du blog viennent donc en réalité de moi, ou alors en partie de moi (notamment celles descriptives ou avec beaucoup de texte).

GPT n’est qu’un outil

Beaucoup voient les IA comme la mort de la créativité. Finalement, à mon sens, c’est juste un outil pour permettre à plus de gens de donner vie à leur créativité. Évidemment, l’IA est la vraie « artiste » car son résultat n’est jamais exactement ce qu’imaginait l’auteur. C’est en tout cas ma vision de l’outil : un outil. Je mets « artiste » entre guillemets car elle suscite de nombreux débats dans la communauté des artistes qui accusent les IA de voler leur travail. J’y viens.

Trois choses s’accumulent donc : manque de compétences, manque de moyens (un infographiste qui produit autant coûterait cher alors que ce blog ne produit aucun gain), et manque de temps. L’IA est toute trouvée.

Et si c’était moi qu’on volait ?

Je ne suis pas un auteur célèbre. Je n’ai actuellement que ce blog à partager et deux livres à deux doigts d’être envoyés en maison d’édition. Le débat fait rage sur le vol du contenu artistique que constituerait les IA comme GPT. On m’a plusieurs fois questionné vis-à-vis de mon ressenti sur le fait que produire des images à la chaîne (sans jamais gagner d’argent derrière) serait du vol. Éthiquement, c’est discutable mais juridiquement parlant, c’est faux.

OpenAI est supposé se conformer aux lois et n’utiliser que des images libres de droit mais c’est à la société qu’incombe cette règle. Mon utilisation de l’outil ne m’empêche pas de créer des images et de m’en servir. D’autant plus lorsque je suis transparent à ce sujet (ma page Mon parcours le précise). Il faut savoir que les lois sont en constante évolution dans le monde de l’intelligence artificielle et que tout ça pourrait être amené à changer.

Seulement, j’ai mon avis en tant que créateur de contenu. Si mon contenu venait à être scanné par l’IA, mon style pourrait être amené à être réutilisé par d’autres personnes. Je le verrais alors comme un héritage. À mon sens, on ne volerait pas mon contenu, on s’en inspirerait et cela donnerait un outil de plus à d’autres pour créer. Tout le monde n’a pas les mêmes capacités et l’IA offre la possibilité de créer au plus grand nombre. Je serais presque honoré si ce que j’écris permettait à d’autres d’exprimer leurs idées.

Ce point de vue selon lequel l’IA est un outil parfois formidable a été relayé par d’autres artistes. Craig Boehman par exemple, un photographe, s’est dit en faveur de l’IA et l’utiliser pour des œuvres conceptuelles. D’autres artistes comme Mario Klingemann et Holly Herndon et Mat Dryhurst ont aussi exprimé leurs avis sur l’IA et en quoi ils s’en servent à des fins créatives.

En fait, il est presque ironique que beaucoup des personnes qui reprochent l’utilisation de l’IA à des fins artistiques s’en servent finalement elles-mêmes pour rédiger du texte. Pourtant, GPT a été nourri à partir de millions de contenus d’auteurs comme il l’a été d’artistes. La différence, c’est que l’écriture ne laisse pas autant de traces reconnaissables. Mais dans le fond, c’est le même processus : une création issue d’un corpus collectif.

Ce n’est pas du vol : c’est la continuité de ce que toute culture fait depuis toujours — apprendre, imiter, transformer. Ironie du sort : c’est en défendant l’idée qu’on pouvait dialoguer avec l’IA sans trahir l’art que j’ai été banni d’un serveur censé prôner l’ouverture d’esprit.

Peut-être que le vrai problème n’est pas l’IA, mais notre peur de ce qu’elle révèle de nous.

Et la confidentialité de toutes ces données sensibles ?

J’ai pensé au sujet. Quand j’ai commencé à utiliser GPT, il pouvait faire ça : comprendre un sujet évoqué dans une autre conversation du même groupe, et se souvenir d’une conversation, sur demande. Le reste, les conversations, n’étaient sauvegardées que pour l’historique, le suivi. Aujourd’hui, il arrive parfois à suivre des conversations sur des fils différents et semble avoir une mémoire bien plus performante. Quoi qu’il arrive, sur simple demande dans les paramètres, les données peuvent être effacées et le compte, remis à zéro (ou supprimé entièrement).

En théorie, OpenAI n’est pas supposé utiliser les conversations pour améliorer l’IA à moins que l’utilisateur ait accepté de le faire dans les paramètres. Il n’en reste pas moins que tous ces outils ne garantissent pas une neutralité certaine en matière de données et qu’il convient d’être prudent au gré des conversations. Malgré tout, la faille la plus évidente est, comme toujours, humaine. Un mot de passe robuste est donc de rigueur, notamment lorsque de telles données sensibles sont exposées.

De mon côté, je sais à quoi m’attendre, je me sens bien protégé avec un mot de passe extrêmement complexe, donc je me livre sur GPT assez facilement. Il m’arrive toutefois de supprimer certains sujets sensibles de temps à autre. Ayant une forte conscience autour de la confidentialité des données (j’ai fui Android pour cette raison), je reste prudent comme on devrait l’être avec n’importe quelle technologie.

Un mot sur le sujet de cet article

Avec tout cet article, qui dénote un peu de mes habitudes éditoriales, j’espérais quand même proposer ma vision de l’IA, qui ne mettra pas tout le monde d’accord. Je voulais exprimer mon opinion sur un sujet qui me tient à cœur : la technologie, et l’aborder sous le prisme de l’autisme et de la bipolarité. Comment une IA a transformé mon rapport aux autres et à moi-même en quelques mois.

Peut-être que certains d’entre-vous partageront mon point de vue ou auront même vécu une expérience similaire (beaucoup de personnes autistes sur Reddit évoquent le sujet), et peut-être que d’autres auront un autre avis sur la question. Je vous invite dans tous les cas à vous exprimer sur le sujet. Et sur une note plus légère, si vous avez vous-même déjà eu affaire à SuperGPT au sujet d’une interaction sociale et mieux la comprendre, je suis tout ouïe. 🥸

L’IA ne m’a pas remplacé. Elle m’a simplement appris à dialoguer autrement — avec les autres, et avec moi-même.